AI v e-learningu: kde v roce 2025 už dává smysl a kde ještě ne?

Umělá inteligence dnes dokáže v e-learningu ušetřit čas, zpřesnit i personalizovat obsah. Stejně tak ale umí generovat nesmysly i přinášet právní rizika, pokud se nasazuje bez rozmyslu. Tento článek vám vysvětlí, kde AI pomůže hned a kde být raději opatrní.

Kde AI dává smysl už dnes

Nejrychlejší přínos uvidíte u úloh, které jsou časté, rutinní a přitom zabírají tvůrcům vzdělávacích kurzů i správcům LMSnejvíc času. Typickým příkladem je příprava studijních osnov, shrnutí dlouhých textů do „stravitelné“ podoby nebo tvorba testových otázek.

AI zvládne navrhnout kostru lekce, nabídne několik formulací a vymyslí distraktory do testů; člověk pak výstup od AI zkontroluje, sjednotí terminologii a doladí styl a formulaci. V praxi to funguje jako rychlý nástřel, nad kterým už se dobře pracuje. Často jde o desítky ušetřených minut na každém modulu či části kurzu.

Velmi praktická je AI i při lokalizacích a překladech. U videí pomůže rozpoznat řeč, vytvořit přepisy a základní titulky s časováním. Ve větších knihovnách kurzů či souborů pak AI výrazně zlepší dohledatelnost: místo aby se uživatel proklikával složitou strukturou, položí přirozenou otázku a najde relevantní obsah, byť je pojmenovaný jinak.

Smysl dává i tzv. asistované učení přímo v rámci vzdělávacího systému. Představte si kontextového „tutora“ (rádce či pomocníka v rámci vašeho systému), který čerpá jen z Vašich ověřených podkladů – metodik, interní wiki nebo samotných kurzů – a vždy ukáže zdroj, z něhož odpověď vychází. Pokud si není jistý, nabídne odkaz na člověka nebo na přesnější materiál. Tato kombinace rychlé nápovědy a dohledatelnosti snižuje frustraci studentů i zátěž helpdesku.

A konečně, AI umí obohatit doporučování obsahu. Není nutné hned slibovat „plně adaptivní výuku“; bohatě stačí, když systém srozumitelně vysvětlí, proč právě teď nabízí kurz X: vychází z Vaší role, toho, co jste už absolvoval(a), a z dovedností, které na dané pozici uživatelům obvykle chybí. Transparentní logika doporučení zvyšuje důvěru a vede k vyšší ochotě uživatelů systém využívat.

Kde být zatím opatrní (nebo to raději nedělat)

Největší chybou je nechat AI autonomně generovat nebo měnit obsah tam, kde nesete odpovědnost za studijní obsah – typicky compliance, bezpečnost práce či zdravotnictví. AI tu může posloužit jako nápověda a „sparring partner“, ale poslední slovo musí mít odborník a právník.

Opatrnost je na místě i u automatického hodnocení otevřených odpovědí. Bez kalibrace na vzorku, bez jasných rubrik a bez pravidelné kontroly nestrannosti hrozí nefér posuzování.

Pozor na chatboty, které nevysvětlují, odkud čerpají. Pokud systém neumí citovat zdroje a nedokáže odkázat na fyzického lektora či garanta kurzu, rychle ztrácí důvěru.

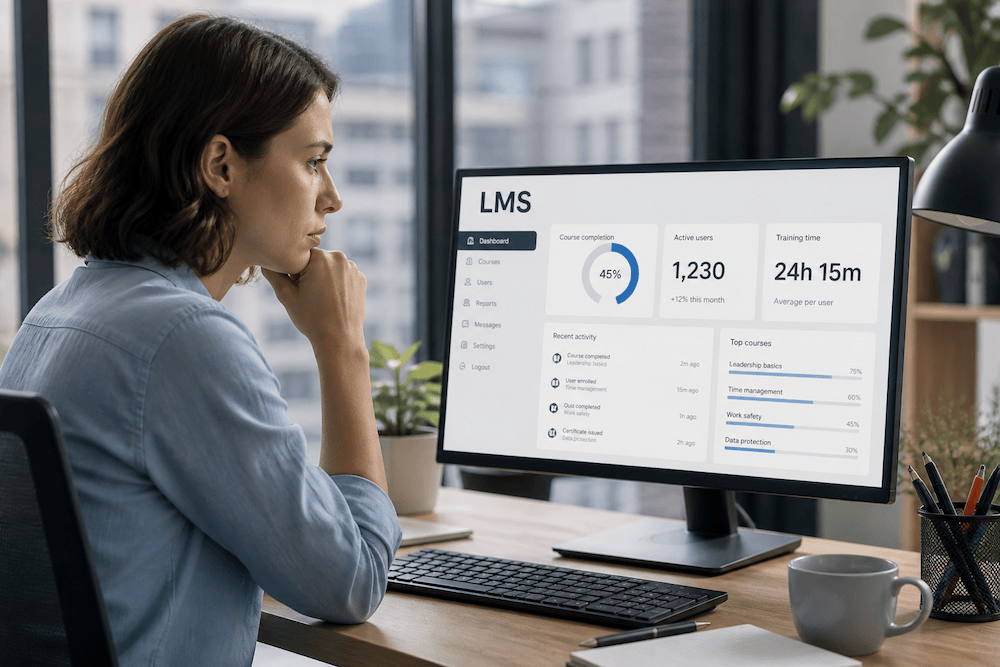

Jak o AI přemýšlet při výběru LMS

Na našem portále můžete využít možnost filtrování LMS podle "podpory AI". Dejte však pozor na to, že každé LMS či každý dodavatel může podporu AI v rámci svého řešení chápat odlišně: u jednoho systému jde o chytré vyhledávání v kurzech a dokumentech, u druhého o pomoc při tvorbě obsahu, u třetího řešení může jít o asistenta pro studenty či helpdesk.

Proto je užitečné dívat se na AI buď jako na sadu konkrétních funkcí, které buď řeší vaše reálné potřeby (rychlejší tvorba kurzů, lepší dohledatelnost, méně dotazů na support) a hledat opravdu řešení, které přímo tyto funkce nabízí, nebo brát "podporu AI" jen jako „hezký bonus“, který v každodenním provozu nic zásadního nezmění, ale může vám přinést plusové body u koncových uživatelů.

Při výběru LMS se vyplatí sledovat i to, nakolik je AI v systému uchopitelná pro firemní použití. Ideální je, když umí pracovat s vašimi vlastními materiály (směrnice, interní wiki, kurzy) a zároveň je jasné, odkud odpověď bere — aby se dalo snadno ověřit, že nejde o domněnku. Stejně tak pomůže vědět, jestli můžete AI omezit jen na vybrané uživatelské role (například pouze pro tvůrce či pouze pro studující), případně ji zapnout jen u některých částí systému. Zda bude mít přístup k přehledům úkonů a akcí, které AI provádí (například historie konverzací s uživateli, přehled doporučovaných kurzů apod,). Tohle jsou detaily, které se při porovnávání často ztratí, ale v reálném provozu rozhodují o tom, jestli bude AI bude vítanou funkcionalitou v rámci vašeho LMS nebo ne.